NVIDIA 工程師說「失去它像被切掉一隻手」,Codex 開始參與自己的優化,長文本能力直接翻倍

2026 年 4 月 23 日,OpenAI 正式發表 GPT-5.5,如果只看標題、只看 benchmark 的幾個百分點差異,我們暫且感覺不到 GPT-5.5 和過去兩年每隔幾個月都會更新的模型有什麼差異。但仔細看每一個附帶的技術細節、每一條 OpenAI 特意放出的案例,你會發現這次其實不只是一次新模型發表,而是 OpenAI 正在把「AI 作為工具」的定位,真正推到「AI 作為員工」的分水嶺。

這篇深度解析,挑出這次發表裡六個真正值得拆開來看的訊號,一條一條讀它背後的策略與技術意義,最後再回到企業端:當 Agent 能力曲線又往上跳一階,對於 EgentHub 上的企業客戶有什麼樣的啟發?

文章目錄

- 更聰明,但速度不變

- Agentic coding 的真正改變:從「補程式」到「看懂系統的形狀」

- OpenAI 自己 85% 員工每週用 Codex

- 科學研究:AI 第一次參與新定理的證明

- 長文本躍進:MRCR v2 從 36.6% 跳到 74.0%

- 上架與定價:比 5.4 貴一點,但效率同步提升

- 結語:這是體檢表,不是升級通知

一、更聰明,但速度不變

GPT-5.5 的第一個明顯改變,是它在 Agentic coding、電腦操作、知識工作、科學研究四條戰線都有顯著進步,但 OpenAI 特別強調一件事:「實際服務延遲與 GPT-5.4 持平」。對沒在做推論基礎建設的人,這句話可能像行銷包裝;但對跑過 production 的人,這是非常不尋常的陳述。

過去每一代旗艦模型都在反覆驗證一個定律:更聰明通常等於更大,更大通常等於更慢。GPT-4 到 GPT-4.5,GPT-4.5 到 GPT-5,每一次都要在「能力 vs. 延遲」之間取捨,GPT-5.5 這次把這兩條曲線暫時脫鉤,不是靠「換個 variant」做到的,它是在同一個模型、同樣的智慧水準上,把推論棧整個往前推了一代。

OpenAI 揭露的細節也證實了這不是偶然,這一代模型是與 NVIDIA GB200 / GB300 NVL72 系統從一開始就 co-design、co-train、co-serve 的,且 OpenAI 用 Codex 分析數週的產線流量,再讓 Codex 寫出客製化的啟發式演算法,把 token 產出速度多推高了 20%。換句話說,這一代的效率提升,有一部分是 Codex 自己幫忙改出來的,也就是說,這是「AI 自己在改進 AI」,未來這件事情會不會擴大到模型訓練、評估、甚至架構設計本身,值得整個產業關注。

而對企業端最直接的意義在於,過去 Agent 架構設計時最常見的速度/推理能力取捨,可能在一兩代之後就不再必要。EgentHub 上那種「簡單任務用 Gemini 3 Flash、複雜步驟切換 Claude Opus 4.7」的模型編排,未來會逐步被「一顆模型吃到底」取代;而這件事本身,也會反過來影響企業怎麼設計知識庫切片、怎麼配置工具清單、怎麼寫提示詞。

二、Agentic coding 的真正改變:從「補程式」到「看懂系統的形狀」

在 benchmark 層面,GPT-5.5 刷新了多項 agentic coding 紀錄:Terminal-Bench 2.0 從 GPT-5.4 的 75.1% 跳到 82.7%,SWE-Bench Pro 達 58.6%,內部 Expert-SWE(人類中位完成時間約 20 小時的長時程任務)達 73.1%。而且這三個數字的提升,是在 token 用量同步下降的前提下達成的。

但真正值得深挖的,不是這些數字,而是早期測試者的回饋,而這些回饋共同指向一個改變:GPT-5.5 開始能「看懂系統的整體形狀」。

這句話聽起來抽象,但 Dan Shipper(Every 創辦人)的案例把它講得非常具體,他自己在一個 app 上線後踩了雷,一個詭異的後端問題讓他除錯了好幾天都修不好,最後請來資深工程師才靠重寫一塊系統解掉。為了驗證 GPT-5.5 的能力,他把狀態倒回當時那個「壞掉、但不知道哪裡壞」的 snapshot,並且問模型:你能不能自己推出我那位工程師最後選的那條重構路線?GPT-5.4 答不出來,GPT-5.5 答出來了,套 Shipper 的話:「這是我用過第一個有真正概念清晰度(conceptual clarity)的程式模型」。

另一個例子更戲劇化。Pietro Schirano(MagicPath CEO)丟了一個含大量前端改動和 refactor 的分支,請 GPT-5.5 合併進一個主幹、也同步變動過的 main branch,一般這種情況至少得手動處理一輪;GPT-5.5 在約 20 分鐘內,一次就把衝突完全解掉。Schirano 的評價是:「你真的感覺在跟一個更高階的智慧合作,甚至會對它產生某種敬意。」

也難怪某位拿到早期存取的 NVIDIA 資深工程師會說:「失去 GPT-5.5 就像被切掉了一隻手(losing a limb)。」

這三段回饋的共通特徵是,不只是「工具變好」,而是「工作關係改變」。從「我要告訴它該做什麼」變成「我把狀況丟給它,它自己推理出要做什麼」。這個轉變,對 Agent 設計者的意義非常大,過去 Agent 架構裡「流程圖 + 步驟化」這條路徑,會開始轉向「提供系統視角 + 模型自己規劃」。

三、OpenAI 自己 85% 員工每週用 Codex

很多人讀 OpenAI 公告,會把「超過 85% 的員工每週使用 Codex」這個數字當成行銷亮點跳過,這個數字的背後意義其實很重要:

第一,這是 OpenAI 在告訴整個產業:AI Agent 已經不再是「特定角色在用的工具」,而是橫跨工程、財務、公關、行銷、資料科學、產品管理的基礎設施。85% 這個數字本身,等於在定義「正常的 AI 採用率」應該長什麼樣子。企業內部 AI 導入率一旦跟不上這個數字,就會開始在採用曲線上落後。

第二,OpenAI 舉的三個內部案例,都刻意挑了「多步驟、跨工具、含判斷」的工作流,而不是「幫我寫一封信」這種單點任務:

- 公關團隊用 GPT-5.5 分析過去六個月對外發言請求的紀錄,訓練並驗證一個 Slack agent,讓低風險請求自動處理掉。

- 財務團隊用 Codex 審閱 24,771 份 K-1 報稅表、71,637 頁文件,把作業時程比去年縮短了整整兩週。

- 業務拓展團隊有員工把每週業務報告自動化,一週省下 5 到 10 小時。

這三個案例可以看出,OpenAI 不是在告訴我們「AI 會寫東西」,而是在示範「Agent 能串起一整個業務流程」。

第三,ChatGPT 這次把 GPT-5.5 Pro 推向 Pro、Business、Enterprise 使用者,強調的是「商業、法律、教育、資料科學」這四個領域,全部都是高推理、高領域知識密度的工作,也就是說,GPT-5.5 Pro 的戰略定位,並不是瞄準一般消費者,而是瞄準「成為你辦公室裡最聰明的那位同事」。

回到企業視角,這條邏輯對正在 EgentHub 上設計 Agent 的團隊,意義也很直接:過去幾年顧問團隊最常花時間做的事,是透過結構提示詞(角色、任務、執行流程、輸出格式),加上知識庫類型選擇(全文查找、表格查詢、向量檢索),再串上 MCP 工具,讓 Agent 可以接住整段業務。GPT-5.5 出來後,這類 Agent 的能力天花板馬上被抬高一階,而能力被抬高的直接後果,是過去為了繞過模型短板所做的許多複雜設計,未來可以被大幅簡化。

知識工作類的 benchmark,也側面印證這點:GDPval(勝過或平手人類白領專家)84.9%、OSWorld-Verified 78.7%、Tau2-bench Telecom(完全沒調過 prompt)98.0%、內部投資銀行建模 88.5%。這些數字的共同點是,它們測的都不是「單點能力」,而是「在真實業務情境裡完成一整段工作的能力」。

四、科學研究:AI 第一次參與新定理的證明

先看 benchmark,GPT-5.5 在遺傳學與計量生物學的多階段資料分析 benchmark(GeneBench)上大幅超越 GPT-5.4;在真實世界生資分析 benchmark(BixBench)上,拿下公開成績模型中的領先位置。這兩個 benchmark 的共同特徵是——它們測的不是單一問題的答案,而是一整條從資料處理、統計分析、假設驗證、到結論生成的研究流程。

但真正具有象徵意義的是這件事:OpenAI 內部版本的 GPT-5.5,搭配自研 harness,協助發現了一個關於 Ramsey number 的新證明,一個關於 off-diagonal Ramsey number 的漸近性質,而且後來還以 Lean 完成形式化驗證。Ramsey number 是組合數學最中心的課題之一,這類問題的每一次重大推進都是組合數學界的大事件,讓 AI 實際參與到「新定理的證明」這個動作,算是一次嶄新的嘗試。

其他案例也同樣有代表性:

- 美國 Jackson Laboratory for Genomic Medicine 的免疫學教授 Derya Unutmaz,用 GPT-5.5 Pro 分析一份 62 個樣本、近 28,000 個基因的資料集,產出一份他形容「團隊原本要做幾個月」的研究報告。

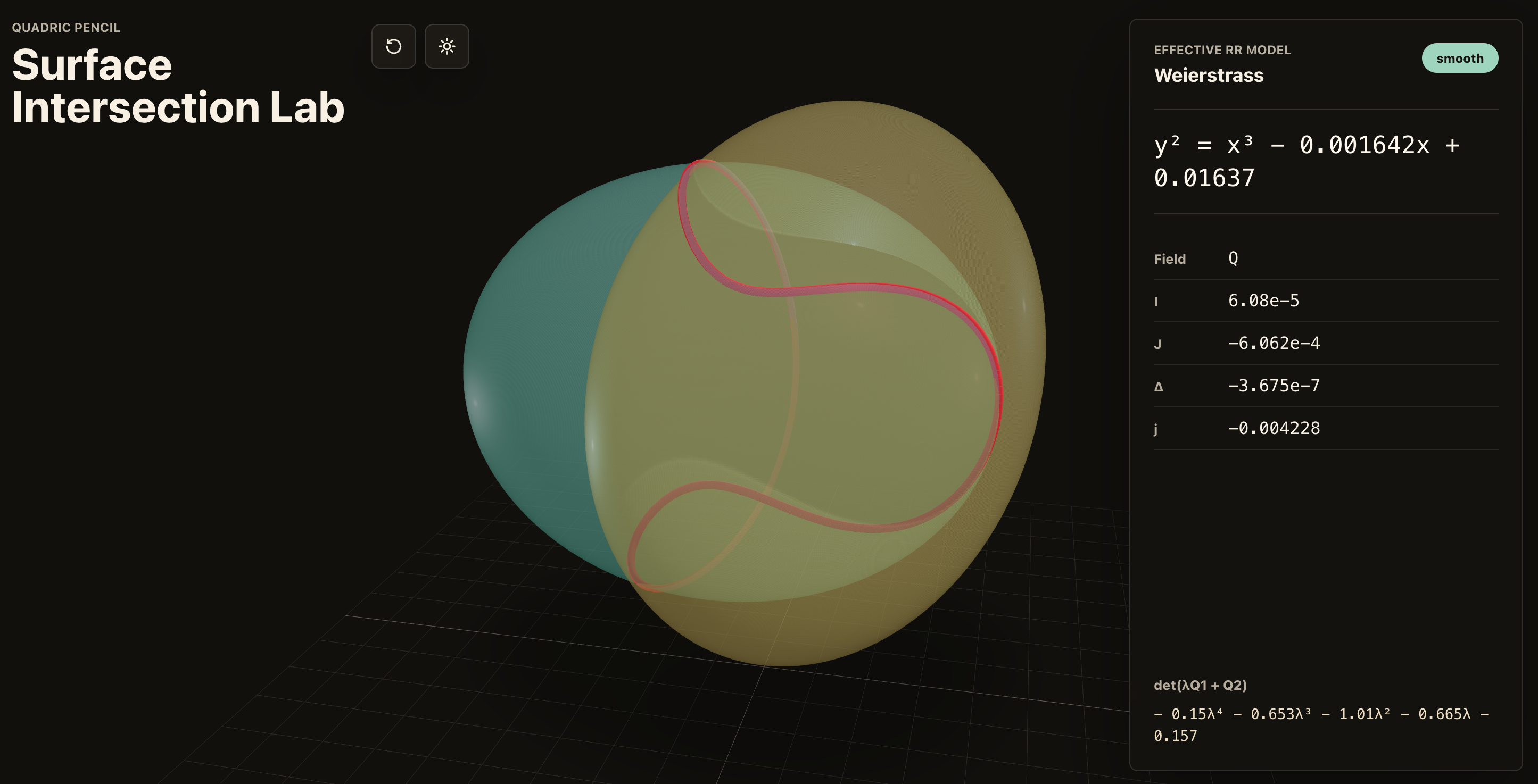

- 波蘭 Adam Mickiewicz 大學的數學助理教授 Bartosz Naskręcki,用 GPT-5.5 在 Codex 裡,只靠一個 prompt、11 分鐘,就建好一個代數幾何 app。

這段的訊號很清楚:科學研究的門檻,正在被 AI 以數量級的方式壓低。這對產業端的意義,短期內可能還不明顯,但中期會開始外溢,包含醫療、材料、能源、生技,這些需要大量跨領域推理的產業,會是下一波 Agent 導入的主戰場。

五、長文本躍進:MRCR v2 從 36.6% 跳到 74.0%

這次發表裡有一個數字,如果不是熟悉長文本評測的人,很容易漏掉:OpenAI MRCR v2 的 8-needle 512K–1M 長文本測試裡,GPT-5.5 達到 74.0%,而 GPT-5.4 只有 36.6%。競品 Claude Opus 4.7 在這個指標上是 32.2%。

這組數字的意義需要拆開來看。MRCR(Multi-Round Coreference Resolution)這類長文本 benchmark,測的不是「模型能不能把一本書讀完」,而是在一段極長的 context 裡,模型能不能精準地追蹤多條彼此交織的線索。8-needle 的意思是,測試在 context 裡埋了八個彼此有關的「針」,模型必須同時找到全部八個。

從 36.6% 跳到 74.0%,這在技術面幾乎是翻倍,代表的是長文本能力從「能讀」跨到「能用」的一個關鍵門檻:

- 多文件交叉分析會變得可行。 過去要做「比對三份合約的條款差異」「整合五份技術規格書」,模型常因為文件過長就開始失焦,長文本能力翻倍後,這類任務第一次真正落入可交付區間。

六、上架與定價:比 5.4 貴一點,但效率同步提升

- ChatGPT:GPT-5.5 Thinking 開放 Plus、Pro、Business、Enterprise;GPT-5.5 Pro 限 Pro、Business、Enterprise。

- Codex:Plus、Pro、Business、Enterprise、Edu、Go 全方案開放,context window 達 400K;Fast mode 的 token 產出速度快 1.5 倍、但成本 2.5 倍。

- API(即將推出):gpt-5.5 為每百萬輸入 tokens $5、每百萬輸出 tokens $30,context window 達 1M;gpt-5.5-pro 為每百萬輸入 $30、每百萬輸出 $180。Batch 與 Flex 半價,Priority 2.5 倍。

價格比 GPT-5.4 貴,但因為 token 效率同步提升,實際使用成本不一定更高。而且對企業而言,真正重要的從來不是「每百萬 token 多少錢」,而是「同一個業務任務,新模型要花多少 token、需要多少次重試才能交付」,這兩個數字,GPT-5.5 都壓得比前代更低。

結語:這是體檢表,不是升級通知

總的來說,GPT-5.5 很可能成為 OpenAI 重新奪回最佳模型王座的反攻號角。過去將近半年,人們開始鼓吹、讚嘆 Gemini 3 Pro 有多強、Opus 4.6(甚至最近推出的 4.7)是如何取代大量複雜的開發任務。而 GPT-5.5 具備所有滿足上述條件的能力:

- Agent 開始掌管一整個流程,而不只是一個指令、單點的任務。

- 長文本能力翻倍,多文件場景的設計邏輯會被重寫。

- OpenAI 自己 85% 員工每週使用 Codex,AI 從 Good-to-Have 變成 Must-Have。

- 科學研究第一次被 AI 明確推進,逐漸外溢到需要跨領域推理的產業。

- Codex 開始參與自己的優化,「AI 改進 AI」進入可量化的早期階段。

- 能力跳一階、護欄也必須同步收緊,企業端的權限與治理架構越來越不可或缺。

期待 OpenAI、GPT 重新回到王座的那一天,畢竟巨頭在正向競爭下更能激發出潛能(促銷補貼),造福更多 AI 使用者與企業。

本文由智慧方案 EgentHub 顧問團隊撰寫,持續追蹤 AI 模型動態與企業應用趨勢。 了解更多 AI Agent 導入方案:egenthub.com