目錄

- 發布背景與市場意義

- GPT-5.4 Mini:速度與可靠性兼具的專業二哥

- GPT-5.4 Nano:為高通量任務而生的數位工蜂

- 原生電腦操控與視覺識別能力

- 價格與規格對比分析

- 企業如何善用輕量化模型紅利

發布背景與市場意義

面對 Google 發布號稱性價比天花板的 Gemini 3.1 Flash-Lite,OpenAI 顯然不打算讓對手專美於前。繼兩週前推出 GPT-5.4 Thinking 之後,OpenAI 於 2026 年 3 月 18 日再度出手,正式發布 GPT-5.4 Mini 與 GPT-5.4 Nano 兩款輕量化模型。

從企業 AI 實務應用的角度觀察,這次發布具有顯著的戰略意義。各大模型廠商的戰線已從旗艦級擴展到效能比戰場,效能紅利戰正式成為一條成型的支線。這對企業而言代表一個關鍵轉變:降低對旗艦模型的依賴成為可能,AI 應用正式進入高 CP 值時代。

核心亮點速覽:

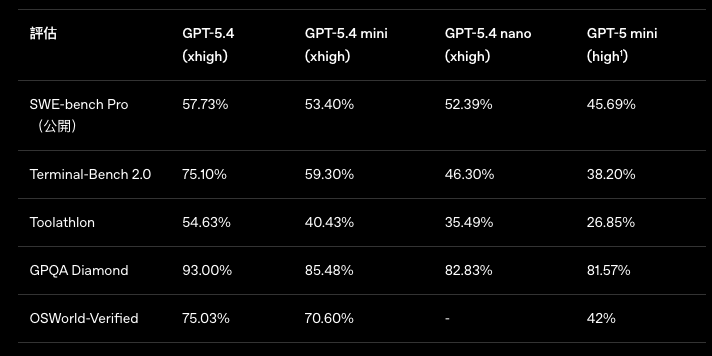

- 速度飛躍:GPT-5.4 Mini 運行速度較前代提升超過 2 倍,xhigh 模式下的推理能力已逼近旗艦等級

- 跑分驚人:Mini 在 SWE-Bench Pro 達到 53.4%,OSWorld-Verified 更衝上 70.6%

- 價格破壞:Nano 每百萬輸入 Token 僅 $0.20,全面壓過競爭對手

- 視覺與電腦操作:原生支援多模態理解、Computer Use,並配備 400k 超長上下文視窗

GPT-5.4 Mini:速度與可靠性兼具的專業二哥

在企業 AI Agent 的日常運作中,EgentHub 顧問經常與客戶分享一個觀點:「最強的模型未必是最合適的模型。」當場景需要即時回應的編碼助手或客服代理時,任何延遲都會嚴重損害使用者體驗。GPT-5.4 Mini 的定位正是那位手腳俐落、專業度卻不遜色的得力助手。

這次 Mini 最讓業界震撼的並非速度本身,而是它的穩定度。在早期企業客戶 Hebbia 的實測中,GPT-5.4 Mini 的端到端任務通過率甚至超越了體積更大的旗艦版 GPT-5.4,尤其在來源引用標註的準確度上表現更為突出,徹底打破了「小模型必定輸大模型」的固有印象。

在技術指標方面,Mini 於 xhigh 推理模式下的 SWE-Bench Pro(53.4%)與 OSWorld-Verified(70.6%)成績,充分證明它已具備應對真實世界軟體工程場景的硬實力。對於需要頻繁除錯、前端開發或低延遲即時對話的企業場景來說,Mini 目前提供了市場上最出色的智力成本比。

GPT-5.4 Nano:為高通量任務而生的數位工蜂

如果 Mini 扮演的是專業助理角色,那麼 GPT-5.4 Nano 就是名副其實的數位工蜂。它是 GPT-5.4 系列中體積最小、反應最快的成員,專為「高通量、低單價」的重複性任務量身打造。

Nano 在架構上相當適合擔任子智能代理(Sub-agent),負責處理大規模的分類、資料擷取、排序以及簡易輔助工作。在企業級部署中,Nano 能同時處理成千上萬份文件的初步清洗,把旗艦模型的算力留給最終的戰略決策。

定價方面更是極具競爭力:每百萬輸入 Token 僅需 $0.20,輸出為 $1.25。對比同期發布的 Gemini 3.1 Flash-Lite(輸入 $0.25、輸出 $1.50),OpenAI 這回顯然有備而來,用銅板價直接壓縮了對手的定價空間。

對企業來說,這無疑是一大利多——不僅能真正推進 AI 民主化,更能切實達成降本增效的目標。

原生電腦操控與視覺識別能力

這次 GPT-5.4 Mini 與 Nano 最令人矚目的突破,在於它們繼承了旗艦版的視覺與電腦操控原生能力。隨著龍蝦(OpenClaw)的爆紅,Computer Use 正加速成為 AI 模型的標配功能。

兩款模型現在具備強大的視覺識別能力,能讀取螢幕截圖並理解複雜的 UI 元件。這對擁有老舊系統且缺乏 API 接口的傳統產業來說是一大福音。過去導入 AI 時,串接 Legacy System 往往需要開發昂貴的連接器;如今透過 Computer Use,AI 可以像真人一樣看著螢幕操作滑鼠、填寫表單,輕鬆突破舊系統的自動化瓶頸。

這種「大模型負責規劃、小模型負責執行」的 A2A 協作架構,正成為 2026 年的主流工作模式。搭配 400k 超長上下文視窗,Mini 與 Nano 在處理大型程式碼庫或厚重技術文件時,仍能維持一定水準的記憶精準度,確保長鏈任務不會出現記憶衰退問題。

價格與規格對比分析

在 2026 年的 AI 戰場上,這對兄弟檔的定價極具破壞力:

- GPT-5.4 Mini:每百萬輸入 Token $0.75 / 輸出 $4.50

- GPT-5.4 Nano:每百萬輸入 Token $0.20 / 輸出 $1.25

對比市場上的直接競爭對手,Nano 在輸入與輸出端均較 Gemini 3.1 Flash-Lite 更便宜。不過企業在使用時也要留意部分限制:在 Codex 應用中,Mini 雖然效能強悍,但僅占用 GPT-5.4 旗艦版 30% 的配額。

ChatGPT 平台方面,Free 與 Go 方案用戶已可透過「思考」功能體驗 Mini;Pro 等級用戶則會在旗艦模型達到速率限制時,自動以 Mini 作為強力後備,確保工作流程不會中斷。

企業如何善用輕量化模型紅利

這次更新帶來的關鍵洞察是:單一模型包辦所有任務的時代已經結束。隨著企業 AI 數位轉型日趨成熟,導入 EgentHub 一段時間的客戶已開始學會追求最高效能比,靈活搭配不同模型來完成各種任務,構建一套「大腦負責思考、手腳負責執行」的協作體系。

最佳實踐策略是:將高難度的戰略規劃交給 GPT-5.4 Pro 等旗艦模型,而把大規模、高頻率的執行任務交給 Mini 與 Nano 這類輕量模型。這正是 EgentHub 平台的核心優勢所在——支援多模型自由配置與 MCP 串接功能,能依據任務複雜度自動選擇最經濟、最快速的模型,並將 AI 的能力直接接上企業內部的業務系統。