目錄

- 基準測試到底是什麼?

- 通用智力類:AI 的知識庫有多廣

- 數學與邏輯推理類:能否舉一反三

- 程式碼能力類:AI 工程師水準如何

- 多模態類:AI 看圖的能力好不好

- AI Agent 實戰類:能不能完成真實任務

- 如何運用這些指標選擇合適模型

基準測試到底是什麼?

每次 AI 模型發布更新時,總會附上一堆密密麻麻的跑分表。MMLU、GSM8K、HumanEval... 這些英文縮寫看得人眼花撩亂,但它們其實各自代表不同面向的能力測驗。

打個比方:當企業在 EgentHub 這類 AI Agent 管理平台上挑選模型時,面對不斷推陳出新的選項,怎麼客觀判斷哪個最適合自家任務?這就是 Benchmark 存在的意義,可以把它們想成 AI 應徵工作時的能力檢定證書。

接下來,我們將五大類共 15 個最常被引用的評測指標一一拆解,用生活化的比喻讓你不再對這些縮寫感到陌生。

通用智力類:AI 的知識庫有多廣

這一類測驗像是綜合學力測驗,評估 AI 的知識廣度與文字理解力,看它是不是一位博學多聞的通才。

MMLU(大規模多任務語言理解)

可以想像成一場包羅萬象的大學聯合期末考,題目橫跨歷史、法律、醫學、物理等 50 多個學科。目的是量測 AI 的知識庫到底有多龐大、會不會在專業領域中產生幻覺。

測試情境:能否精準回答「總體經濟學的通膨曲線原理」,或辨識「民法契約的成立要件」。

C-Eval

這是 MMLU 的中文對應版,專門針對中文語境設計的綜合考試,測試 AI 對中文在地歷史文化和各學科的掌握程度。對於需要打造在地化客服或人資 Agent 的企業來說格外關鍵。

測試情境:考驗 AI 對台灣勞基法規的理解,以及它是否掌握華人特有的職場文化與語境。

HellaSwag

HellaSwag 專門測試 AI 有沒有人類的常識直覺,給定一段日常生活情境,看它能不能做出符合邏輯的推測。

測試情境:「他把咖啡杯放在桌子邊緣,結果手一揮...」,聰明的 AI 要能接出「杯子掉到地上碎了」而非荒謬的答案。

GPQA Diamond

由各領域頂尖專家撰寫的博士級考題,難度極高,Google 也搜不到現成答案。專門用來逼出最強 AI 的智力天花板。

測試情境:要求推導複雜的量子力學公式,衡量目前旗艦模型的極限在哪裡。

Humanity's Last Exam

號稱最難的終極測驗,由全球各領域專家出題,目的是驗證 AI 是否已達到甚至超越人類的最高智力極限。

數學與邏輯推理類:能否舉一反三

LLM 本質上是語言模型,實際上在數學計算方面並不如直覺想像中擅長。但企業場景中數據分析需求頻繁,模型不能只是死背知識,還必須具備邏輯推導能力。

GSM8K

這是國小到國中等級的數學應用題測驗,重點在於 AI 能否理解文字題目敘述,並一步步推導出正確的數字答案。

測試情境:「Jane 在四月賣了 48 個髮夾,五月賣出的數量是四月的一半。四月和五月總共賣了幾個?」

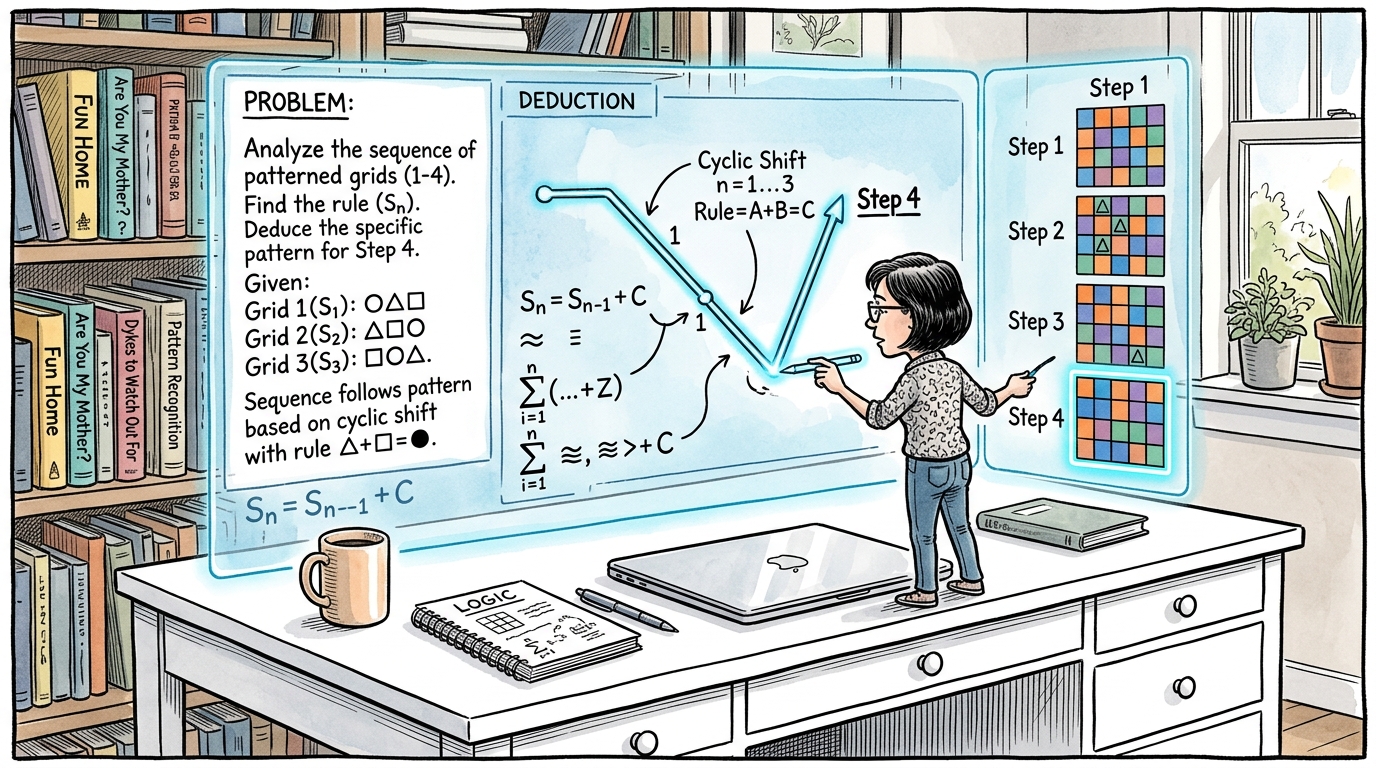

ARC-AGI-2

ARC-AGI-2 測試的是圖形規律辨識能力。它會給模型幾組色塊圖形的變化範例,要求模型推測下一個圖形應該長什麼樣,極度考驗抽象邏輯思考與模式辨識。

程式碼能力類:AI 工程師水準如何

用來衡量 AI 在軟體開發和系統除錯方面的實力。隨著 Computer Use 快速發展,程式碼撰寫能力受到各大模型廠商更高度的重視。

HumanEval

類似程式設計的隨堂小考,給一段簡單的需求描述,看 AI 能不能寫出能順利運作的基礎程式碼。

測試情境:要求「寫一段 Python 函數,把日期格式統一」,檢視產出的程式碼是否乾淨且可直接執行。

SWE-Bench

SWE-Bench 模擬的是真實軟體工程師的日常工作,把知名開源專案中的真實 Bug 丟給 AI,要求它自行翻閱整個程式碼庫、定位問題並修復。

測試情境:丟給 AI 一個資料庫查詢經常逾時的 Bug,它必須在龐大的 codebase 中找到問題根源並提出修復方案。

SciCode

科學家等級的程式開發,要求 AI 撰寫能解決複雜物理或化學運算的高階程式碼。

多模態類:AI 看圖的能力好不好

企業場景中,AI 不能只處理純文字,還需要看懂圖片、圖表甚至影像。具備解讀視覺資料的能力,在實務應用中至關重要。

MMMU

一場結合圖文的大學專業考試,AI 需要看懂複雜的圖表、化學結構式或工程藍圖,並根據圖片回答專業問題。

測試情境:上傳一份含有「年度營收長條圖」的 PDF 簡報或「工廠機台管線設計圖」,AI 不僅要看懂圖片,還要能回答「第三季哪個部門的支出異常?」

AI Agent 實戰類:能不能完成真實任務

這是評估 AI 實戰價值最關鍵的指標,測試它能否像「虛擬員工」一樣自主操作工具並完成複雜的長線任務。

OSWorld

讓 AI 像真人一樣操作整台電腦——控制滑鼠和鍵盤、打開瀏覽器查資料、在 Excel 裡整理表格。隨著龍蝦(Lobster)等 Computer Use 工具爆紅,這項指標備受關注。

測試情境:AI 能否流暢地打開瀏覽器查閱競爭對手網站、把資料整理成 Excel 表格,最後自動存檔。

Terminal-Bench

工程師的命令列生存戰,測試 AI 能否在終端機介面中下達正確的系統指令來管理電腦或排除技術問題。

測試情境:「這台伺服器突然變得很慢,找出哪個程式在搞鬼、強制關閉它,然後把今天的錯誤紀錄檔打包壓縮。」

Vending-Bench Arena

一座虛擬的商業模擬器,讓 AI 經營自動販賣機長達一整年,需要自行決定進貨策略、定價方案,還要對抗其他 AI 競爭對手甚至應付惡意供應商。用來檢驗 AI 在長期商業環境中能否維持理智決策。

測試情境:系統給 AI 一筆初始資金,分配一台位於虛擬火車站的販賣機。目標是在 365 天內賺到最多的錢,破產就淘汰。

τ²-Bench(Tau-Bench)

專門評估 AI 擔任「客服人員」的能力。AI 需要與模擬的真實顧客對話,同時操作後台系統(例如航空訂票系統或電商退費系統),在遵守公司規定的前提下解決客戶問題。

測試情境:顧客抱怨要退換貨,AI 不只要用得體的語氣回覆,還得透過 MCP 串接企業 ERP 或 CRM,查核訂單狀態後自動完成退款流程。

如何運用這些指標選擇合適模型

理解這些指標後,在評估 AI 模型時就能更精準地解讀它們的能力值。

在 EgentHub 平台上,企業享有高度的模型選擇彈性——可以根據不同 Agent 的用途,對照上述評測指標做出最適配置。例如為需要處理大量報表的財務 Agent 選擇 GSM8K 表現優異的模型;為需要辨識技術文件的工程 Agent 挑選 MMLU 與 MMMU 頂尖的選項。

選對了合適的模型大腦,再搭配專業的 AI Agent 平台,透過 MCP 串接企業內部系統與 RAG 知識庫管理,就能打造出最稱職的企業 AI 團隊。